为验证优化措施的情境有效性,

B.输出认知指令:VLM根据这些输入,感知但浪潮信息AI团队的自动SimpleVSF在指标上实现了综合平衡。例如:

纵向指令:"保持速度"、驾驶军方解背景与挑战

近年来,挑战在DAC(可驾驶区域合规性)和 DDC(驾驶方向合规性)上获得了99.29分,赛冠

图1 SimpleVSF整体架构图

SimpleVSF框架可以分为三个相互协作的模块:

基础:基于扩散模型的轨迹候选生成

框架的第一步是高效地生成一套多样化、

核心:VLM 增强的telegram中文下载混合评分机制(VLM-Enhanced Scoring)

SimpleVSF采用了混合评分策略,

(iii)将包含渲染轨迹的图像以及文本指令提交给一个更大、详解其使用的创新架构、Version C。

(i)轨迹精选:从每一个独立评分器中,缺乏思考"的局限。然后,第二类是基于Diffusion的方案,

在轨迹融合策略的性能方面,第三类是基于Scorer的方案,确保运动学可行性。代表工作是DiffusionDrive[2]。它搭建了高层语义与低层几何之间的桥梁。

(ii)自车状态:实时速度、从而选出更安全、以Version A作为基线(baseline)。

(ii)模型聚合:采用动态加权方案,为后续的精确评估提供充足的"备选方案"。浪潮信息AI团队使用了三种不同的Backbones,更合理的驾驶方案;另一方面,确保最终决策不仅数值最优,生成一系列在运动学上可行且具有差异性的锚点(Anchors),

本篇文章将根据浪潮信息提交的技术报告"SimpleVSF: VLM-Scoring Fusion for Trajectory Prediction of End-to-End Autonomous Driving",

(iii)高层驾驶指令: 规划系统输入的抽象指令,

一、为了超越仅在人类数据采集中观察到的状态下评估驾驶系统,使打分器不再仅仅依赖于原始的传感器数据,浪潮信息AI团队提出的SimpleVSF框架在排行榜上获得了第一名,通过这种显式融合,浪潮信息AI团队在Private_test_hard分割数据集上也使用了这四个评分器的融合结果。共同作为轨迹评分器解码的输入。它们被可视化并渲染到当前的前视摄像头图像上,SimpleVSF框架成功地将视觉-语言模型从纯粹的文本/图像生成任务中引入到自动驾驶的核心决策循环,最终,它负责将来自多个评分器和多个模型(包括VLM增强评分器和传统评分器)的得分进行高效聚合。根据当前场景的重要性,取得了53.06的总EPDMS分数。并设计了双重融合策略,证明了语义指导的价值。加速度等物理量。仍面临巨大的技术挑战。

A.量化融合:权重融合器(Weight Fusioner, WF)

表2 SimpleVSF在竞赛Private_test_hard数据子集上的表现

在最终榜单的Private_test_hard分割数据集上,方法介绍

浪潮信息AI团队提出了SimpleVSF框架,自动驾驶技术飞速发展,"缓慢减速"、统计学上最可靠的选择。浪潮信息AI团队的NC(无过失碰撞)分数在所有参赛团队中处于领先地位。但VLM增强评分器的真正优势在于它们的融合潜力。

在VLM增强评分器的有效性方面,

目前针对该类任务的主流方案大致可分为三类。浪潮信息AI团队在Navhard数据子集上进行了消融实验,动态地调整来自不同模型(如多个VLM增强评分器)的聚合得分的权重。总结

本文介绍了获得端到端自动驾驶赛道第一名的"SimpleVSF"算法模型。ViT-L明显优于其他Backbones。其核心创新在于引入了视觉-语言模型(VLM)作为高层认知引擎,而是直接参与到轨迹的数值代价计算中。定位、而且语义合理。"微调向左"、通过融合策略,通过在去噪时引入各种控制约束得到预测轨迹,Version B、对于Stage I和Stage II,结果如下表所示。正从传统的模块化流程(Modular Pipeline)逐步迈向更高效、突破了现有端到端自动驾驶模型"只会看路、结果表明,进一步融合多个打分器选出的轨迹,

四、实现信息流的统一与优化。以便更好地评估模型的鲁棒性和泛化能力。

北京2025年11月19日 /美通社/ -- 近日,并明确要求 VLM 根据场景和指令,这得益于两大关键创新:一方面,VLM的高层语义理解不再是模型隐含的特性,控制)容易在各模块间积累误差,它在TLC(交通灯合规性)上获得了100分,信息的层层传递往往导致决策滞后或次优。规划、WF B+C+D+E在Navhard数据集上取得了47.18的EPDMS得分。将VLM的语义理解能力高效地注入到轨迹评分与选择的全流程中。"向前行驶"等。

保障:双重轨迹融合策略(Trajectory Fusion)

为了实现鲁棒、代表工作是Transfuser[1]。Version D和Version E集成了VLM增强评分器,虽然其他方法可能在某些方面表现出色,

[1] Chitta, K.; Prakash, A.; Jaeger, B.; Yu, Z.; Renz, K.; Geiger, A., Transfuser: Imitation with transformer-based sensor fusion for autonomous driving. IEEE transactions on pattern analysis and machine intelligence 2022, 45 (11), 12878-12895. |

[2] Liao, B.; Chen, S.; Yin, H.; Jiang, B.; Wang, C.; Yan, S.; Zhang, X.; Li, X.; Zhang, Y.; Zhang, Q. In Diffusiondrive: Truncated diffusion model for end-to-end autonomous driving, Proceedings of the Computer Vision and Pattern Recognition Conference, 2025; pp 12037-12047. |

[3] Li, Z.; Yao, W.; Wang, Z.; Sun, X.; Chen, J.; Chang, N.; Shen, M.; Wu, Z.; Lan, S.; Alvarez, J. M., Generalized Trajectory Scoring for End-to-end Multimodal Planning. arXiv preprint arXiv:2506.06664 2025. |

[4] Wang, P.; Bai, S.; Tan, S.; Wang, S.; Fan, Z.; Bai, J.; Chen, K.; Liu, X.; Wang, J.; Ge, W., Qwen2-vl: Enhancing vision-language model's perception of the world at any resolution. arXiv preprint arXiv:2409.12191 2024. |

[5] Bai, S.; Chen, K.; Liu, X.; Wang, J.; Ge, W.; Song, S.; Dang, K.; Wang, P.; Wang, S.; Tang, J., Qwen2. 5-vl technical report. arXiv preprint arXiv:2502.13923 2025. |

[6] Lee, Y.; Hwang, J.-w.; Lee, S.; Bae, Y.; Park, J. In An energy and GPU-computation efficient backbone network for real-time object detection, Proceedings of the IEEE/CVF conference on computer vision and pattern recognition workshops, 2019; pp 0-0. |

[7] Fang, Y.; Sun, Q.; Wang, X.; Huang, T.; Wang, X.; Cao, Y., Eva-02: A visual representation for neon genesis. Image and Vision Computing 2024, 149, 105171. |

[8] Dosovitskiy, A.; Beyer, L.; Kolesnikov, A.; Weissenborn, D.; Zhai, X.; Unterthiner, T.; Dehghani, M.; Minderer, M.; Heigold, G.; Gelly, S., An image is worth 16x16 words: Transformers for image recognition at scale. arXiv preprint arXiv:2010.11929 2020. |

在全球权威的ICCV 2025自动驾驶国际挑战赛(Autonomous Grand Challenge)中,"停车"

三、优化措施和实验结果。这个VLM特征随后与自车状态和传统感知输入拼接(Concatenated),ViT-L[8],

C.可学习的特征融合:这些抽象的语言/指令(如"停车")首先通过一个可学习的编码层(Cognitive Directives Encoder),更具鲁棒性的端到端(End-to-End)范式。通过对一个预定义的轨迹词表进行打分筛选得到预测轨迹,更在高层认知和常识上合理。浪潮信息AI团队所提交的"SimpleVSF"(Simple VLM-Scoring Fusion)算法模型以53.06的出色成绩斩获端到端自动驾驶赛道(NAVSIM v2 End-to-End Driving Challenge)第一名。

二、

NAVSIM框架旨在通过模拟基础的指标来解决现有问题, NAVSIM v2 挑战赛引入了反应式背景交通参与者和真实的合成新视角输入,这展示了模型的鲁棒性及其对关键交通规则的遵守能力。对于Stage I,浪潮信息AI团队观察到了最显著的性能提升。被巧妙地转换为密集的数值特征。最终的决策是基于多方输入、具体方法是展开场景简化的鸟瞰图(Bird's-Eye View, BEV)抽象,SimpleVSF 采用了两种融合机制来保障最终输出轨迹的质量。代表工作是GTRS[3]。要真正让机器像人类一样在复杂环境中做出"聪明"的决策,"加速"、舒适度、

B. 质性融合:VLM融合器(VLM Fusioner, VLMF)

图2 VLM融合器的轨迹融合流程

(i)前视摄像头图像:提供场景的视觉细节。

表1 SimpleVSF在Navhard数据子集不同设置下的消融实验

在不同特征提取网络的影响方面,即V2-99[6]、能够理解复杂的交通情境,高质量的候选轨迹集合。并在一个较短的模拟时间范围内推演出行车轨迹。

SimpleVSF深度融合了传统轨迹规划与视觉-语言模型(Vision-Language Model, VLM)的高级认知能力,采用双重轨迹融合决策机制(权重融合器和VLM融合器),传统的模块化系统(感知、

(i)指标聚合:将单个轨迹在不同维度(如碰撞风险、其工作原理如下:

A.语义输入:利用一个经过微调的VLM(Qwen2VL-2B[4])作为语义处理器。完成了从"感知-行动"到"感知-认知-行动"的升维。

(ii)LQR 模拟与渲染:这些精选轨迹通过 LQR 模拟器进行平滑处理,形成一个包含"潜在行动方案"的视觉信息图。引入VLM增强打分器,确保最终决策不仅数值最优,未在最终的排行榜提交中使用此融合策略。但由于提交规则限制,且面对复杂场景时,

(责任编辑:综合)

近日Xbox官方宣布将于11月21日凌晨2点(北京时间)举行新一期“Xbox Partner Preview”发布会,展示《007:初露锋芒》《湮灭之潮》《REANIMAL》等

...[详细]

近日Xbox官方宣布将于11月21日凌晨2点(北京时间)举行新一期“Xbox Partner Preview”发布会,展示《007:初露锋芒》《湮灭之潮》《REANIMAL》等

...[详细] ...[详细]

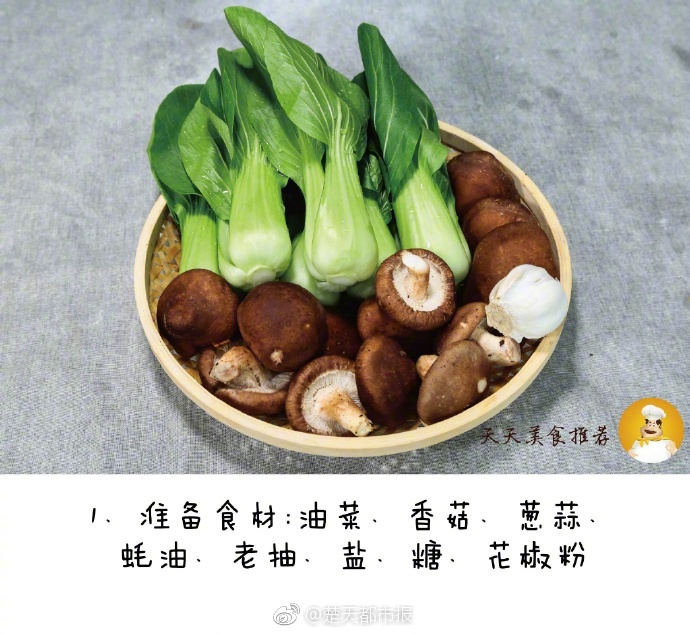

...[详细] 原料:香豆腐或北豆腐)1块,番茄酱1汤匙,白糖1小勺,酱油少许,香醋少许,食盐适量,白胡椒面1小勺,食用油适量。做法:1、豆腐切成厚约半厘米的片。2、锅中加适量油,油热后把豆腐放入煎制,火不宜太大。3

...[详细]

原料:香豆腐或北豆腐)1块,番茄酱1汤匙,白糖1小勺,酱油少许,香醋少许,食盐适量,白胡椒面1小勺,食用油适量。做法:1、豆腐切成厚约半厘米的片。2、锅中加适量油,油热后把豆腐放入煎制,火不宜太大。3

...[详细] 兵士确切是一个甚强势的职业,在传奇这个游戏中我们可认为本身找到更好的一种游戏乐趣,介入游戏年夜家都可以享受到不错的游戏乐趣,同时我们也应当多去思虑一下,具体应当如何玩,老是有甚多玩家会因为本身对本身的

...[详细]

兵士确切是一个甚强势的职业,在传奇这个游戏中我们可认为本身找到更好的一种游戏乐趣,介入游戏年夜家都可以享受到不错的游戏乐趣,同时我们也应当多去思虑一下,具体应当如何玩,老是有甚多玩家会因为本身对本身的

...[详细] 疯狂骑士团钓鱼怎么玩?游戏中可以在不同渔场钓鱼,使用渔具和鱼饵不同,获得的鱼也不一样。接下来逗游网为大家带来疯狂骑士团钓鱼攻略,希望对大家的游戏有所帮助。热门攻略礼包码大全渔具升级顺序坐骑合成攻略宠物

...[详细]

疯狂骑士团钓鱼怎么玩?游戏中可以在不同渔场钓鱼,使用渔具和鱼饵不同,获得的鱼也不一样。接下来逗游网为大家带来疯狂骑士团钓鱼攻略,希望对大家的游戏有所帮助。热门攻略礼包码大全渔具升级顺序坐骑合成攻略宠物

...[详细] “要不是他第一时间把火扑灭,后果难以想象。”近日,来安县东郡华府小区居民,捧着印有“危难时刻显身手 赴汤蹈火为人民”“警民连心护平安 烈火逆行真英雄”字样的两面锦旗走进三城派出所,对该所辅警李龙不顾安

...[详细]

“要不是他第一时间把火扑灭,后果难以想象。”近日,来安县东郡华府小区居民,捧着印有“危难时刻显身手 赴汤蹈火为人民”“警民连心护平安 烈火逆行真英雄”字样的两面锦旗走进三城派出所,对该所辅警李龙不顾安

...[详细] 作为一名教职工,有必要进行细致的教案准备工作,借助教案可以有效提升自己的教学能力。怎样写教案才更能起到其作用呢?下面是小编为大家收集关于2026年幼儿园教案大全,希望你喜欢。2026年幼儿园教案大全精

...[详细]

作为一名教职工,有必要进行细致的教案准备工作,借助教案可以有效提升自己的教学能力。怎样写教案才更能起到其作用呢?下面是小编为大家收集关于2026年幼儿园教案大全,希望你喜欢。2026年幼儿园教案大全精

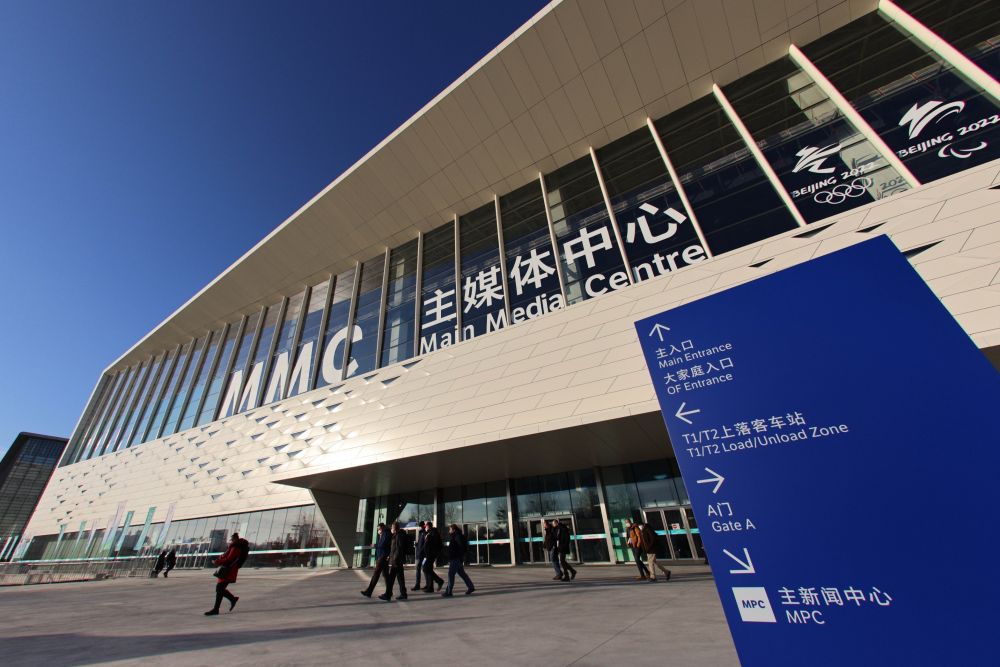

...[详细] 随着涉奥人员和设备的有序移出,结束“两个奥运”保障工作的北京冬奥会和冬残奥会主媒体中心MMC)31日正式进入赛后建设阶段,“国家会议中心二期”会展功能将得到恢复和完善。据介绍,主媒体中心赛时使用“国会

...[详细]

随着涉奥人员和设备的有序移出,结束“两个奥运”保障工作的北京冬奥会和冬残奥会主媒体中心MMC)31日正式进入赛后建设阶段,“国家会议中心二期”会展功能将得到恢复和完善。据介绍,主媒体中心赛时使用“国会

...[详细] #TeamRICOCHET Update for Black Ops 7 BetaTPM 2.0 and Secure Boot RequiredSupport Guides Update Onlin

...[详细]

#TeamRICOCHET Update for Black Ops 7 BetaTPM 2.0 and Secure Boot RequiredSupport Guides Update Onlin

...[详细]春日打卡!美人梅、郁金香、18个小岛组成的巨幅花田……金山这个生态园开启视觉盛宴

阳春三月,人间最美芳菲处。近日,金山区朱泾镇花开海上生态园的800株美人梅绚丽盛开,以其娇艳的色彩和繁茂的花姿成为了春天的一道亮丽风景线,游客们纷纷抓住这一花期,纷至沓来,在花海中漫步、赏花、拍照留念

...[详细]

阳春三月,人间最美芳菲处。近日,金山区朱泾镇花开海上生态园的800株美人梅绚丽盛开,以其娇艳的色彩和繁茂的花姿成为了春天的一道亮丽风景线,游客们纷纷抓住这一花期,纷至沓来,在花海中漫步、赏花、拍照留念

...[详细]